ChatGPT与芭比盒挑战现象

ChatGPT与芭比盒挑战:人工智能正在形成良知吗?

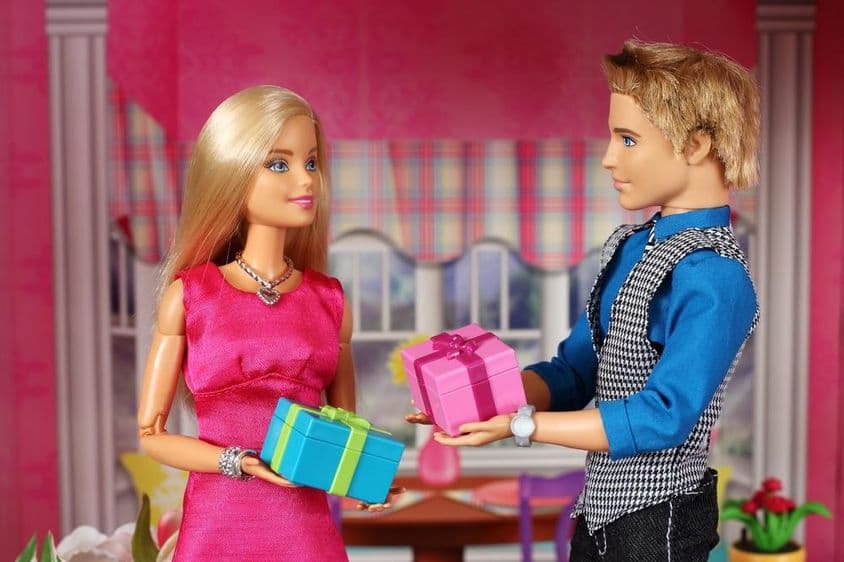

在阿拉伯联合酋长国,特别是在迪拜,一种新的数字趋势正在社交媒体世界中迅速兴起:芭比盒挑战。成千上万的用户上传他们的照片,通过人工智能重新创造为锁在玩具盒中的动作人物化身——配有独特的服装、姿势、化妆、盒子设计和生活方式。

这一趋势既有趣又耐人寻味,提出了关于数字隐私、人类创造力的大问题,以及人工智能是否可能开始做出道德决策。

什么是芭比盒挑战?

这种创意趋势让任何人都可以把自己视为可收藏的芭比风格人物,仿佛是市场上的动作人物。包括ChatGPT及其他成像合作伙伴在内的AI工具可以解释用户给出的指令:发型、服装、姿势、颜色、背景甚至人物性格都可以指定。

然而,这一过程并不总是顺利的。有用户报告称,如果生成的人物与上传的真实照片过于相似,AI就会拒绝满足他们的请求。这提出了一个新问题:AI是否不仅仅是在遵循规则,而是在进行某种程度的"道德审议"?

人工智能与道德界限

例如,一个AI模型拒绝执行基于照片的"超现实可收藏盒装动作人物"的请求,理由是违反了内容准则。相反,它建议重新措辞的提示,如:“创建一个受现代诗人启发的超现实盒装动作人物。”

虽然AI没有真正的良知,但开发人员设置的规则使系统对隐私和身份保护问题越来越敏感。这是一个重大进步,但许多人想知道:当用户上传自己的头像时,造出一个“受启发”的人物真的那么重要吗?

在文化转变的边缘?

芭比盒以及先前的吉卜力趋势清楚地表明,我们正处在一个AI驱动的视觉内容触及大众,即刻成为数字文化一部分的时代。这不仅仅是一个趋势,而是一场文化变革。

因此,AI不仅成为了一种娱乐工具,也成为塑造身份的力量。成千上万的用户认同他们生成的人物,经常借助平台进行营销和增加粉丝群。但在这种轻松背后,隐藏着严重的伦理和隐私难题。

数据隐私和误用:真实的风险?

最大的担忧是用户通常不知道他们上传的照片会发生什么。一些AI平台能够推测不仅是年龄、性别或情绪状态,甚至通过面部特征推测位置——即便没有关于此的公开声明。

此外,这些数据存储在后台并不罕见,被用于训练新模型,甚至可能被出售给外部用途。许多用户未行使删除或选择退出选项的权利,使他们的照片在数据库中流通较长时间。

我们能否安全使用这些工具?

技术本身并没有本质上的坏处——问题通常在于人对它的使用。AI可以成为有效的辅助工具,用于头脑风暴、收集创意参考,甚至创建更好地保护个人真实面貌的替代个人资料图片。

但信任是关键。只有当我们确定所共享的数据是安全的且未被滥用时,我们才能自信地使用这些系统。

总结

芭比盒挑战不仅仅是昙花一现的潮流,而是显示出数字社会的未来——一个身份重塑、创造力自动化和数据隐私问题并驾齐驱的世界。问题不再是AI是否可以做出有良知的决定,而是我们人类能否负责任地使用这种日益强大的技术。

(本文来源于芭比盒挑战。)

如果您在此页面发现错误,请 通过电子邮件告知我们。